分类和回归树

2025年9月24日

11:44

分类树

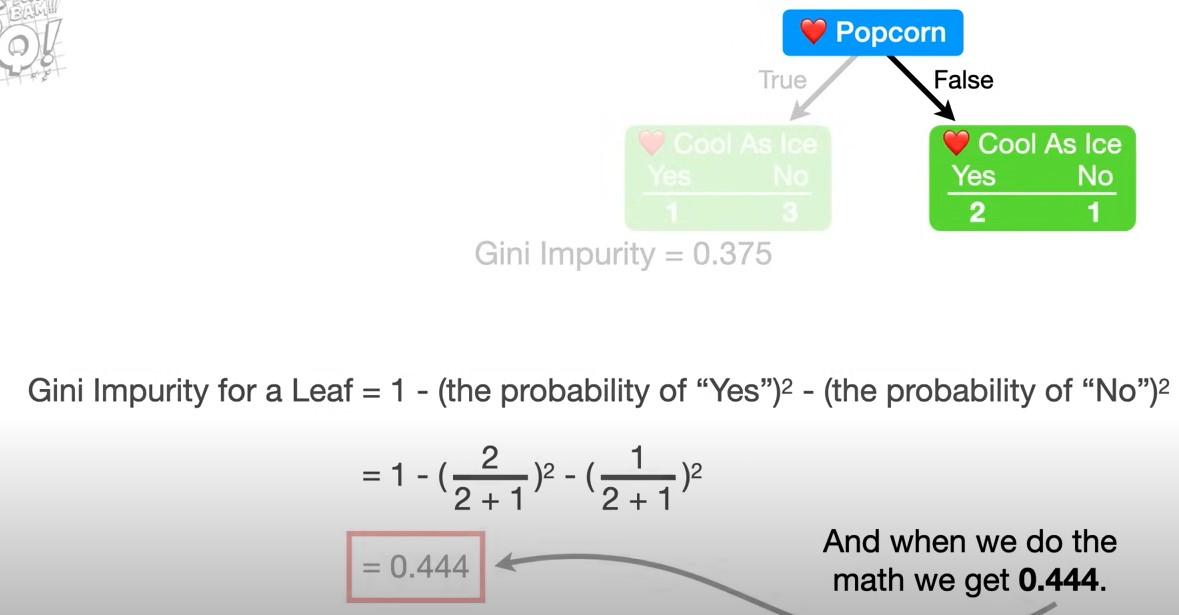

用GINI impurity (熵、信息增益,其实都是一个东西)来衡量一个叶子节点的纯度(不纯度为0,表示这个节点只包含同一个类别的样本),计算公式如下图:

左节点和右节点中包含的样本数量可能是不同的,所以需要对gini impurity乘以一个样本数量相关的权重 ,某个分裂点的gini impurity =左叶子节点和右叶子节点的gini impurity 的加权和,即 w_l*gini_impurity_left_node + w_r*gini_impurity_right_node。

当节点分裂没有信息增益时(或信息增益没有超过某个阈值),就停止分裂,每个节点的输出类别 就是该节点中大多数的类别 。

当某个节点中包含的样本数量太少时(比如只有一个样本),此时很有可能过拟合,所以我们限制每个叶子节点中的最少样本数量 。

对于特征中的缺失值:均值、中位数、众数填充,或者用其他相关列拟合一个线性模型填充,或者用相似样本的值填充。

回归树

回归树也是遍历所有的特征及分裂点,左节点的预测值是左节点中所有数据的label的平均值,右节点同理,用mse而不是gini来评估分裂点的好坏,分裂点的mse=左叶子节点的mse+右节点的mse。